Des enjeux de conformité ?

Contactez-nous pour démarrer le diagnostic de votre conformité à l'AI Act

Nous utilisons des cookies pour améliorer votre expérience, analyser le trafic et personnaliser le contenu. Vous pouvez accepter, refuser ou personnaliser vos choix à tout moment. Politique de confidentialité

Meta title : AI Act 2026 : guide de conformité pour entreprises françaises (PME & ETI)Meta description : L'AI Act évolue : obligations GPAI applicables depuis août 2025, systèmes à haut risque d'ici août 2026. Guide opérationnel pour PME françaises — niveaux de risque, calendrier actualisé, sanctions.Slug : /blog/loi-europeenne-ai-act-guide-operationnel-pour-les-entreprises-francaisesDate de mise à jour : Mars 2026

Depuis août 2024, l'AI Act est entré en vigueur.Ce règlement européen sur l'intelligence artificielle transforme la manière dont les entreprises doivent gérer leurs outils numériques — et le calendrier accélère.

Beaucoup de dirigeants pensent que ce sujet ne les concerne pas encore. Pourtant, votre CRM, vos chatbots, vos systèmes de tri de CV utilisent déjà de l'IA. Et la réglementation ne fait pas de distinction entre ceux qui savent qu'ils utilisent l'IA et ceux qui l'ignorent.

Le risque n'est pas théorique : les sanctions peuvent atteindre 35 millions d'euros ou 7 % du chiffre d'affaires mondial. Plus que le montant, c'est la responsabilité juridique et l'impact réputationnel qui inquiètent les entreprises averties.

Surtout, l'échéance approche : les obligations pour les systèmes à haut risque entrent en vigueur en août 2026, soit dans moins de six mois. Ce guide vous donne les clés pour comprendre concrètement ce qui change, identifier vos zones de risque et mettre en place une conformité AI Act pragmatique avant la date limite.

L'AI Act — officiellement Règlement (UE) 2024/1689 — est le premier règlement mondial qui encadre spécifiquement l'intelligence artificielle.

Son objectif ? Garantir que les systèmes d'IA déployés en Europe respectent les droits fondamentaux des citoyens et des travailleurs. Contrairement aux idées reçues, ce texte ne vise pas à freiner l'innovation. Il établit un cadre pour que l'IA se développe de manière responsable et transparente.

Le règlement s'applique à toute entreprise qui développe, commercialise ou utilise des systèmes d'IA dans l'Union européenne. Peu importe votre secteur ou votre taille. Dès que vous utilisez un outil qui prend des décisions automatisées, analyse des comportements ou traite des données sensibles, vous êtes concerné. Les éditeurs de logiciels SaaS, les plateformes cloud, les solutions RH et marketing tombent presque tous dans le périmètre.

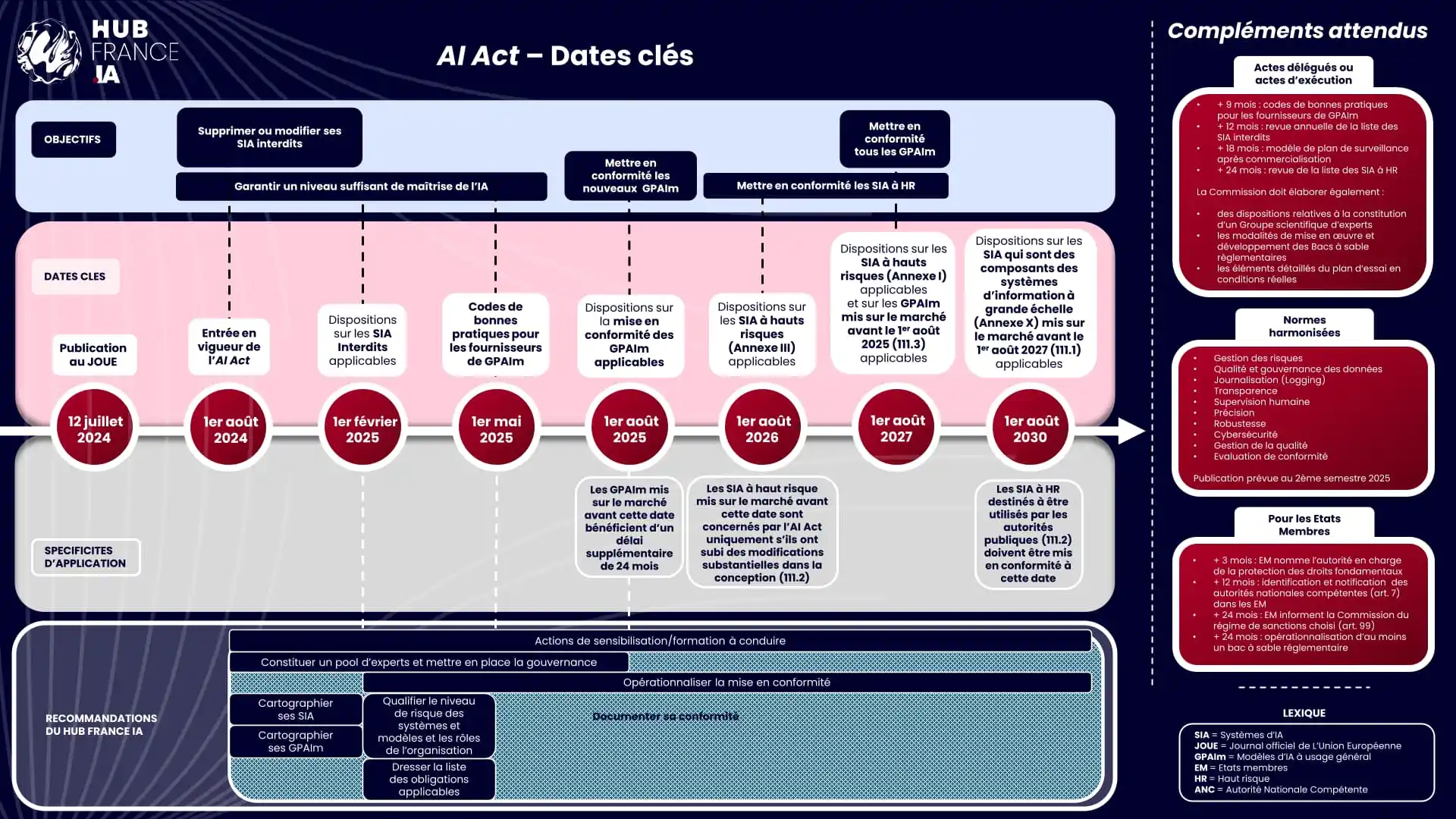

L'AI Act s'applique par phases. Voici le calendrier précis à connaître en mars 2026 :

Cette mise en œuvre progressive crée une zone d'urgence réelle pour 2026. Les entreprises qui anticipent prennent un avantage stratégique sur leurs concurrents. Celles qui attendent s'exposent à une mise en conformité dans l'urgence — avec les coûts et les risques que cela implique.

L'Europe a choisi une approche par les risques plutôt qu'une régulation uniforme. Un chatbot simple n'aura pas les mêmes contraintes qu'un système de recrutement automatisé. Cette granularité rend le texte plus complexe à appréhender, mais elle évite les surcharges réglementaires inutiles.

Vous pensez peut-être ne pas utiliser d'intelligence artificielle. Pourtant, votre entreprise en dépend probablement déjà sans que vous ne l'ayez identifié comme tel.

Les outils modernes intègrent massivement des briques d'IA : filtres anti-spam, recommandations produits, scoring de leads, analyses prédictives. Ces fonctionnalités semblent anodines, mais elles entrent dans le champ de la réglementation dès qu'elles influencent des décisions.

Prenons l'exemple d'un CRM classique. Il propose souvent des scores de maturité pour prioriser les prospects. Ce score repose sur des algorithmes qui analysent des comportements et prédisent des intentions. Techniquement, c'est de l'IA. Si ce score influence vos actions commerciales, vous devenez utilisateur d'un système d'IA au sens de l'AI Act. Même logique pour les outils de marketing automation, les chatbots de support client ou les solutions d'analyse de données.

ChatGPT, Copilot, Gemini et leurs concurrents se sont généralisés en quelques mois. Vos équipes les utilisent pour rédiger des emails, créer du contenu, analyser des documents. Chaque usage constitue un point de contact avec l'AI Act. Et depuis août 2025, ces modèles sont soumis à un cadre réglementaire spécifique — celui des GPAI (modèles d'IA à usage général) — que nous détaillons ci-dessous.

Pour comparer les principaux outils d'IA générative disponibles pour les entreprises françaises, consultez notre article Mistral AI vs ChatGPT : quelle IA choisir en entreprise ?

La question n'est plus de savoir si vous utilisez l'IA, mais combien de systèmes différents traversent votre organisation.

Contrairement à ce que beaucoup imaginent, le règlement ne concerne pas uniquement les développeurs d'IA. Les entreprises utilisatrices portent aussi une responsabilité. Vous devez vérifier que vos fournisseurs respectent leurs obligations, documenter vos usages et garantir une supervision humaine sur les décisions importantes. Le fait de passer par un prestataire ne vous exonère pas.

Depuis août 2025, les fournisseurs de modèles d'IA à usage général (GPAI) — dont font partie GPT-4, Gemini, Claude ou Mistral — sont soumis à des obligations spécifiques supervigées par l'EU AI Office (Bureau européen de l'IA), l'autorité centrale créée par l'AI Act.

Concrètement, qu'est-ce que cela signifie pour votre entreprise ?

Les éditeurs GPAI doivent désormais publier une documentation technique sur leurs modèles, respecter le droit d'auteur et déclarer les données utilisées pour l'entraînement. Les modèles présentant un risque systémique (les plus puissants, comme GPT-4 ou Gemini Ultra) ont des obligations renforcées : tests adversariaux, notification d'incidents, cybersécurité.

Pour vous, en tant qu'entreprise utilisatrice, ces obligations créent de nouvelles vérifications à effectuer auprès de vos fournisseurs IA :

L'absence de politique d'usage interne est aujourd'hui l'une des vulnérabilités les plus fréquentes dans les PME et ETI françaises. Et contrairement à d'autres obligations de l'AI Act, celle-ci s'applique maintenant.

L'AI Act structure ses exigences autour de quatre niveaux de risque. Cette classification détermine les obligations qui pèsent sur vous. Comprendre dans quelle catégorie tombent vos usages est la première étape pour bâtir votre conformité.

Manipulation cognitive, notation sociale à la chinoise, reconnaissance faciale de masse sans autorisation judiciaire, exploitation de vulnérabilités liées à l'âge ou au handicap. Ces usages sont bannis sans exception. Pour la plupart des entreprises françaises, cette catégorie ne pose pas de problème — les systèmes prohibés restent rares dans le monde professionnel standard.

Le risque élevé concentre les obligations les plus contraignantes. Il concerne les systèmes qui peuvent affecter la sécurité ou les droits fondamentaux des personnes. Dans le monde de l'entreprise, cela touche principalement trois domaines : les ressources humaines, la relation client et les décisions financières.

Un logiciel de tri de CV, une analyse automatisée de candidatures vidéo, un système de notation crédit, un outil de détection de fraude entrent dans cette catégorie. Les exigences incluent des tests rigoureux, une documentation technique complète, des audits réguliers et une supervision humaine effective.

En RH, les outils d'aide au recrutement représentent le cas d'usage le plus sensible. Dès qu'un système filtre, classe ou recommande des candidats, il tombe sous le régime du haut risque — peu importe que la décision finale reste humaine. Les entreprises qui utilisent des ATS modernes doivent donc vérifier la conformité de leur éditeur et documenter leur propre usage.

Les chatbots, assistants virtuels et systèmes de génération de contenu entrent dans cette catégorie. Vous devez informer les utilisateurs qu'ils interagissent avec une IA. Votre chatbot affiche-t-il clairement sa nature artificielle ? Vos contenus générés portent-ils une mention explicite ? Ces détails constituent des obligations légales.

Les filtres anti-spam, les correcteurs orthographiques, les systèmes de recommandation produits basiques ne déclenchent aucune obligation spécifique. Même ces systèmes doivent cependant respecter le RGPD et les règles générales de protection des données.

Au-delà des catégories théoriques, l'AI Act impose des changements organisationnels concrets. Ces transformations touchent vos processus internes, votre gouvernance et vos pratiques managériales.

La documentation devient une obligation centrale. Pour chaque système d'IA à risque élevé, vous devez maintenir un dossier technique : fonctionnement de l'algorithme, données utilisées, tests réalisés, risques identifiés, mesures de supervision. Si vous utilisez un outil tiers, vous devez obtenir ces informations de votre fournisseur et vérifier leur cohérence avec votre usage réel.

La gouvernance IA devient une fonction à part entière. Quelqu'un dans votre organisation doit cartographier les usages, évaluer les risques, suivre la conformité et coordonner les actions. Les entreprises matures créent un comité IA qui réunit juridique, technique, métier et direction. Ce comité valide les nouveaux usages, contrôle la conformité des outils existants et pilote les plans de mise en conformité.

Les responsabilités managériales se redéfinissent. Les managers qui déploient des outils d'IA dans leurs équipes ne peuvent plus se contenter de valider un achat. Ils doivent comprendre les risques, former leurs collaborateurs, superviser les décisions et documenter les incidents.

Le risque financier et réputationnel reste la motivation principale pour agir. Les sanctions prévues par l'AI Act atteignent des niveaux dissuasifs : jusqu'à 35 millions d'euros pour les infractions les plus graves. Mais au-delà de l'amende, c'est l'impact médiatique qui inquiète. Une entreprise épinglée pour mauvais usage d'IA perd la confiance de ses clients, de ses candidats et de ses partenaires.

Le coût de l'inaction dépasse largement le coût de la mise en conformité. Les entreprises qui agissent maintenant transforment une contrainte en avantage concurrentiel.

Pour évaluer rapidement votre exposition à l'AI Act, posez-vous ces questions concrètes.

Utilisez-vous des outils qui prennent ou influencent des décisions ? Un CRM qui score vos prospects, un logiciel RH qui filtre les CV, une plateforme marketing qui optimise vos campagnes, un système de tarification dynamique. Chacun repose probablement sur de l'IA.

Vos processus incluent-ils des décisions automatisées ? Validation automatique de crédit, refus de candidature sans intervention humaine, blocage de compte client. Dès qu'une décision importante se prend sans validation humaine effective, le risque réglementaire augmente.

Travaillez-vous avec des données sensibles ou personnelles ? Les données de santé, les informations biométriques, les données RH, les données financières tombent sous une protection renforcée. Le croisement RGPD + AI Act crée des exigences cumulatives.

Pour comprendre comment mettre en conformité vos outils numériques en lien avec la protection des données, consultez notre guide sur le Consent Mode v2 et la conformité Webflow.

Vos équipes utilisent-elles des outils d'IA générative ? ChatGPT, Copilot, Gemini, Claude se sont généralisés. Leur usage professionnel soulève plusieurs questions : où vont les données partagées ? Comment garantir la confidentialité ? Les contenus générés sont-ils vérifiés ? Une utilisation non encadrée expose à des fuites de données et des erreurs factuelles. Depuis août 2025, vos fournisseurs GPAI ont des obligations de transparence que vous pouvez désormais leur demander de justifier.

Si vous répondez oui à au moins deux de ces questions, votre entreprise doit engager une démarche de conformité AI Act. Le diagnostic complet demande un audit approfondi, mais ces questions donnent déjà une première indication.

La conformité AI Act ne se construit pas en un jour. Elle demande une approche méthodique, progressive et pragmatique. L'objectif n'est pas d'atteindre la perfection immédiate, mais de réduire les risques prioritaires tout en maintenant votre activité.

Vous ne pouvez pas gérer ce que vous ne connaissez pas. Listez tous les outils et processus qui utilisent de l'IA, même indirectement. Cette cartographie doit couvrir les achats officiels, mais aussi les outils utilisés par les équipes sans validation formelle. Les Shadow IT et les usages non déclarés représentent souvent les plus gros risques.

Pour chaque outil identifié, collectez : éditeur, finalité, données traitées, niveau d'automatisation, population concernée. Cette base de données devient votre référentiel IA.

Pour voir comment l'IA peut être intégrée concrètement dans des processus d'entreprise, consultez notre article comment un agent IA gère une entreprise en autonomie.

Pour chaque système, déterminez son niveau de risque selon les critères de l'AI Act. Un même outil peut présenter des risques différents selon l'usage. Un chatbot commercial reste à risque limité, mais un chatbot RH qui présélectionne des candidats bascule en risque élevé.

L'évaluation doit aussi considérer vos capacités de maîtrise : disposez-vous de la documentation technique ? Pouvez-vous auditer l'algorithme ? Avez-vous une supervision humaine effective ?

Vous ne pouvez pas tout traiter simultanément. Concentrez-vous d'abord sur les risques élevés, puis les risques limités, enfin les ajustements organisationnels généraux. Les systèmes à haut risque demandent une action rapide avant août 2026. Si vous ne disposez pas de la documentation nécessaire, sollicitez-la auprès de vos éditeurs sans attendre.

Commencez par les ajustements les plus simples : mentions de transparence, documentation basique, processus de supervision. Puis renforcez progressivement : audits techniques, tests de robustesse, plans de contingence. La conformité AI Act n'est pas un projet ponctuel mais un processus continu d'amélioration.

Vos collaborateurs doivent comprendre les enjeux, connaître les règles et adopter les bons réflexes. Cette formation cible plusieurs populations : les managers qui déploient l'IA, les utilisateurs finaux, les équipes techniques, les fonctions support. Les entreprises matures créent des ressources internes : guides pratiques, FAQ, points de contact identifiés.

| Fournisseur | Déployeur | Mandataire | Importateur | Distributeur | |

|---|---|---|---|---|---|

| Risque inacceptable | Interdiction | Interdiction | Interdiction | Interdiction | Interdiction |

| Haut-risque | Obligations pour les fournisseurs d'IA à haut risque | Obligations pour les déployeurs d'IA à haut risque | Obligations pour les mandataires d'IA à haut risque | Obligations pour les importateurs d'IA à haut risque | Obligations pour les distributeurs d'IA à haut risque |

| Risque spécifique en matière de transparence | Obligations pour les fournisseurs d'IA à risque soumis à obligations de transparence | Obligations pour les déployeurs d'IA à risque soumis à obligations de transparence | Aucune obligation | Aucune obligation | Aucune obligation |

| Risque minime | Code de bonnes pratiques | Code de bonnes pratiques | Code de bonnes pratiques | Code de bonnes pratiques | Code de bonnes pratiques |

.webp)

Face aux obligations de l'AI Act, vous pouvez choisir de gérer la conformité en interne ou de vous faire accompagner.

Gérer en interne fonctionne si vous disposez des compétences nécessaires, soit la maîtrise de trois dimensions simultanées : la compréhension réglementaire, l'expertise technique sur l'IA et la connaissance de vos processus métier. Cette triple compétence reste rare. L'approche interne présente des avantages — elle favorise l'appropriation, réduit les coûts directs et renforce votre autonomie. Mais sans expertise spécialisée, vous risquez des angles morts. Un juriste classique maîtrise mal les spécificités techniques de l'IA. Un développeur connaît peu les subtilités réglementaires.

L'accompagnement externe apporte une expertise concentrée. Un partenaire spécialisé dispose d'une connaissance approfondie de la réglementation, d'une expérience multi-clients et d'une méthodologie éprouvée. Il identifie rapidement vos zones de risque et accélère votre mise en conformité avant les échéances 2026.

L'IA reste un sujet hybride qui demande des compétences transverses. Vous ne pouvez pas le traiter uniquement sous l'angle juridique, ni exclusivement sous l'angle technique. L'approche doit croiser conformité réglementaire, architecture technique et réalité métier. Cette transversalité justifie un accompagnement qui apporte ces trois regards simultanément.

Le bon choix dépend de votre maturité actuelle. Si vous débutez sur le sujet, un accompagnement externe structure votre démarche et vous évite les erreurs coûteuses. L'essentiel est de ne pas sous-estimer la complexité du sujet ni surestimer vos capacités internes.

Chez Apsodia, nous accompagnons les entreprises françaises dans leur mise en conformité AI Act avec une approche opérationnelle et pragmatique. Notre positionnement diffère des cabinets juridiques classiques : nous ne faisons pas de conseil juridique pur. Nous traduisons les obligations réglementaires en actions concrètes adaptées à votre contexte business.

Notre expertise croise trois dimensions : la compréhension technique de l'IA, la maîtrise des enjeux réglementaires et la connaissance des réalités opérationnelles des PME et ETI françaises. Cette triple compétence nous permet d'identifier rapidement vos usages d'IA, d'évaluer vos risques réels et de construire un plan de conformité réaliste.

Découvrez comment nous intégrons l'IA dans les processus métier de nos clients sur notre page Intelligence Artificielle.

Nous concentrons notre action sur les entreprises de taille intermédiaire qui utilisent massivement l'IA sans avoir forcément les moyens d'une direction conformité dédiée. Nous les aidons à structurer leur démarche sans mobiliser des ressources disproportionnées.

Notre vision dépasse la simple conformité réglementaire. Nous croyons que l'IA doit être utile, responsable et performante. Utile signifie qu'elle apporte une vraie valeur métier. Responsable implique qu'elle respecte les personnes, les données et les règles. Performante garantit qu'elle améliore réellement vos résultats business.

L'AI Act n'est qu'une première étape. D'autres réglementations suivront. Les usages de l'IA continueront d'évoluer. Notre accompagnement vous prépare à ces changements plutôt que de vous enfermer dans une conformité figée.

Si vous souhaitez évaluer votre situation, nous proposons un audit AI Act qui cartographie vos usages, évalue vos risques et identifie vos priorités. Cet audit dure généralement une à deux semaines et produit un rapport opérationnel avec un plan d'action chiffré. Contactez-nous pour échanger sur votre contexte et définir l'accompagnement le plus adapté.

Exemple concret : découvrez comment nous avons aidé une entreprise à économiser 1 000 € par an grâce à un agent IA de facturation.

Oui, sans exception. Le règlement concerne toute entreprise qui utilise de l'IA dans l'Union européenne, quelle que soit sa taille. Les PME bénéficient de quelques allègements procéduraux, mais les obligations de fond restent identiques. Une entreprise de 20 personnes qui utilise un logiciel de recrutement automatisé a les mêmes responsabilités qu'un grand groupe.

L'AI Act est un règlement européen directement applicable dans tous les États membres. Il ne nécessite aucune transposition en droit national. Depuis août 2024, il constitue un cadre légal contraignant. L'ignorer vous expose à des sanctions administratives et à des risques juridiques en cas de litige.

Les sanctions varient selon la gravité de l'infraction. L'utilisation de systèmes interdits peut coûter jusqu'à 35 millions d'euros ou 7 % du chiffre d'affaires mondial. Le non-respect des obligations sur les systèmes à haut risque atteint 15 millions d'euros ou 3 % du CA. Les manquements de transparence sont sanctionnés jusqu'à 7,5 millions ou 1,5 % du CA. Ces montants maximums s'appliquent rarement, mais ils montrent le niveau de risque.

L'AI Act et le RGPD sont complémentaires mais distincts. Le RGPD encadre le traitement des données personnelles : il s'applique dès qu'une donnée concernant une personne identifiable est collectée ou traitée. L'AI Act encadre spécifiquement les systèmes d'IA : il s'applique dès qu'un outil automatise une décision ou analyse des comportements, que des données personnelles soient impliquées ou non. En pratique, la plupart des systèmes d'IA à haut risque traitent des données personnelles et relèvent donc des deux règlements simultanément. Les entreprises doivent satisfaire aux deux — les obligations s'accumulent, elles ne se substituent pas.

À l'échelle européenne, l'EU AI Office (Bureau européen de l'IA) supervise l'application du règlement, notamment pour les modèles GPAI. En France, plusieurs autorités nationales partagent les responsabilités selon les secteurs concernés. La CNIL (Commission Nationale de l'Informatique et des Libertés) joue un rôle central, notamment sur les croisements RGPD / AI Act. D'autres autorités sectorielles (ACPR pour la finance, HAS pour la santé) peuvent intervenir sur les systèmes d'IA à haut risque dans leurs domaines.

Oui, sur deux plans. Depuis août 2025, les éditeurs d'IA générative (classés GPAI) doivent respecter des obligations spécifiques de transparence et de gestion des risques supervisées par l'EU AI Office. Les entreprises utilisatrices doivent informer leurs interlocuteurs quand elles utilisent l'IA pour produire du contenu. Elles doivent aussi s'assurer que les données partagées avec ces outils ne violent pas la confidentialité ou le RGPD.

Pas nécessairement. L'objectif de l'AI Act n'est pas d'interdire l'IA mais de l'encadrer. Dans la plupart des cas, vous pouvez continuer à utiliser vos outils actuels en ajoutant des mesures de supervision, de documentation et de transparence. Seuls les systèmes qui tombent dans la catégorie "risque inacceptable" doivent être abandonnés — et ils restent rares dans le monde professionnel standard.

Article mis à jour en mars 2026. Pour aller plus loin, consultez également notre guide opérationnel complet sur la loi européenne AI Act pour les entreprises françaises.

Contactez-nous pour démarrer le diagnostic de votre conformité à l'AI Act