Audit de conformité AI Act

Diagnostic personnalisé et plan d'action par nos experts

Nous utilisons des cookies pour améliorer votre expérience, analyser le trafic et personnaliser le contenu. Vous pouvez accepter, refuser ou personnaliser vos choix à tout moment. Politique de confidentialité

Vous avez probablement entendu parler de l'AI Act. Cette réglementation européenne fait couler beaucoup d'encre depuis son adoption, et pour cause : elle redéfinit complètement les règles du jeu pour toutes les entreprises qui utilisent l'intelligence artificielle. Mais entre les articles de presse alarmistes et le jargon juridique, difficile de savoir par où commencer.

La réalité, c'est que la conformité à l'AI Act n'est pas une option. C'est une obligation légale qui concerne potentiellement votre entreprise, que vous utilisiez l'IA pour générer des devis, optimiser votre logistique ou simplement automatiser vos processus internes. Et contrairement à ce qu'on pourrait penser, se mettre en conformité ne signifie pas nécessairement tout chambouler du jour au lendemain.

Dans cet article, nous allons démystifier l'AI Act ensemble. Vous allez comprendre concrètement ce que cette loi implique pour votre entreprise, identifier votre niveau de risque, et découvrir comment transformer cette contrainte réglementaire en opportunité de structuration. Parce qu'au fond, la conformité AI Act, c'est avant tout une question de méthode et d'accompagnement adapté.

L'AI Act est le premier cadre réglementaire complet au monde concernant l'intelligence artificielle. Adopté par l'Union européenne en 2024, il est entré en vigueur progressivement depuis août 2024, avec une application complète prévue pour 2026-2027. Son objectif ? Encadrer l'utilisation de l'IA pour protéger les droits fondamentaux des citoyens européens tout en favorisant l'innovation.

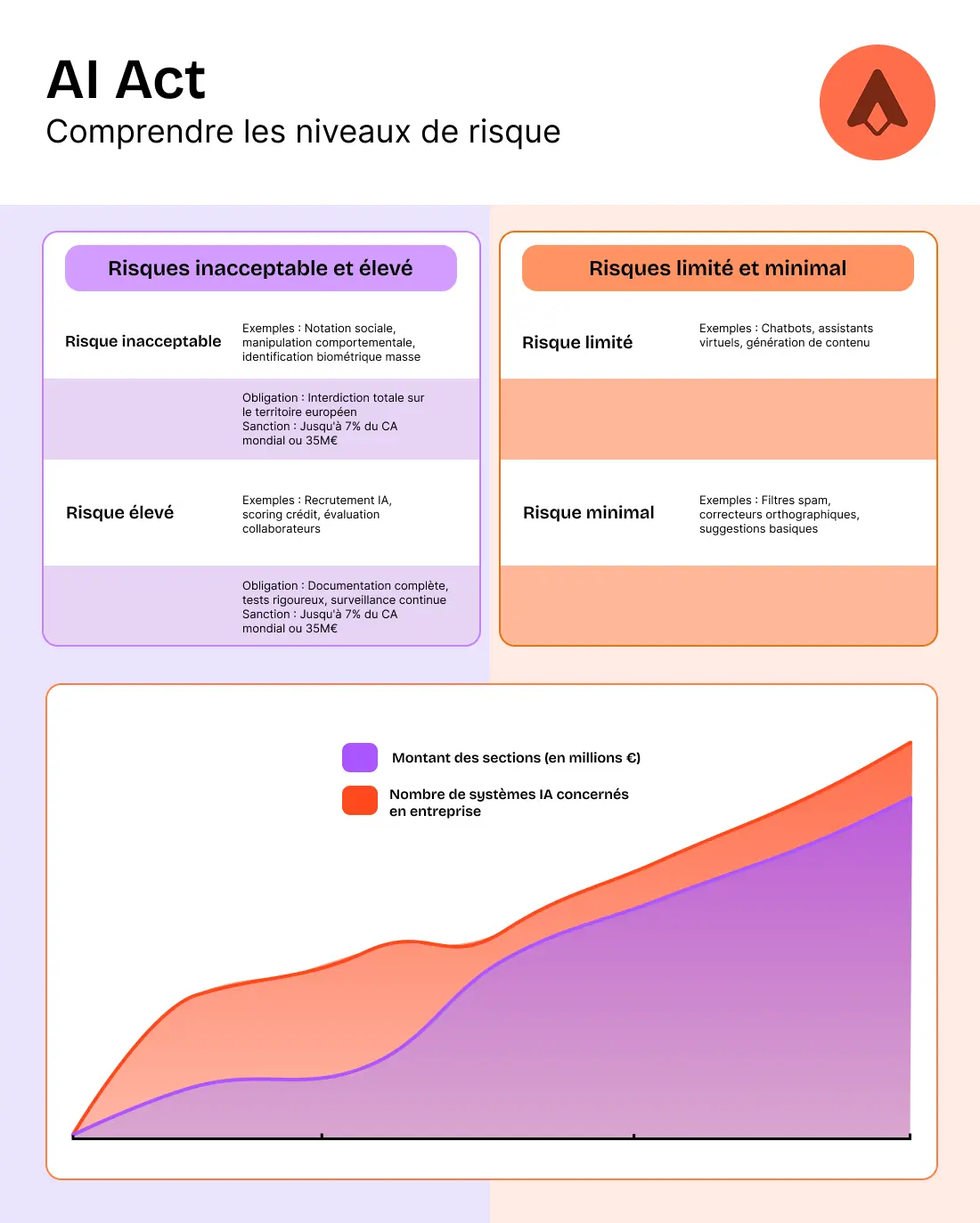

Concrètement, l'AI Act classe les systèmes d'IA selon quatre niveaux de risque, de l'inacceptable au minimal. Cette classification n'est pas anodine : elle détermine directement vos obligations légales et les sanctions auxquelles vous vous exposez en cas de non-conformité. Les amendes peuvent atteindre jusqu'à 7% du chiffre d'affaires mondial annuel pour les infractions les plus graves.

Mais au-delà des sanctions, la vraie question est ailleurs. La conformité AI Act représente une opportunité de structurer vos pratiques, de sécuriser vos processus et de rassurer vos clients. C'est aussi un argument commercial de plus en plus différenciant, particulièrement dans les appels d'offres où la conformité réglementaire devient un critère de sélection.

La logique de l'AI Act repose sur une approche proportionnée : plus le risque est élevé, plus les obligations sont strictes. Voici comment ces quatre niveaux se traduisent concrètement :

| Niveau de risque | Exemples d'applications | Obligations | Sanctions potentielles |

|---|---|---|---|

| Risque inacceptable | Notation sociale (crédit social), manipulation comportementale, identification biométrique en temps réel dans l’espace public | Interdiction pure et simple | Jusqu’à 35M€ ou 7% du CA mondial |

| Risque élevé | Systèmes RH (recrutement, évaluation), scoring crédit, santé, infrastructures critiques | Documentation complète, traçabilité, surveillance humaine, évaluation de conformité | Jusqu’à 15M€ ou 3% du CA mondial |

| Risque limité | Chatbots, générateurs de contenu, assistants virtuels | Obligation de transparence (informer que c’est une IA) | Jusqu’à 7,5M€ ou 1,5% du CA mondial |

| Risque minimal | Filtres anti-spam, suggestions simples, outils de productivité basiques | Aucune obligation spécifique (bonnes pratiques recommandées) | Non applicable |

Cette classification peut sembler théorique, mais elle a des implications très pratiques. Si vous utilisez l'intelligence artificielle pour gérer vos processus RH, vous êtes automatiquement dans la catégorie "risque élevé". Si vous avez un chatbot sur votre site web, vous êtes en "risque limité" et devez simplement informer vos visiteurs qu'ils échangent avec une IA.

Beaucoup d'entreprises abordent l'AI Act comme une contrainte administrative supplémentaire. C'est une erreur. La conformité AI Act est en réalité un levier de performance et de différenciation.

D'abord, parce qu'elle vous oblige à documenter et structurer vos usages de l'IA. Combien d'entreprises utilisent aujourd'hui ChatGPT, Claude ou d'autres outils d'IA sans vraiment savoir qui fait quoi, avec quelles données, et pour quels résultats ? La conformité vous force à mettre de l'ordre dans tout ça, ce qui améliore naturellement la qualité de vos processus.

Ensuite, parce que vos clients et partenaires sont de plus en plus sensibles à ces questions. Dans les secteurs réglementés (finance, santé, RH), la conformité AI Act devient rapidement un prérequis. Les grands comptes commencent à l'exiger de leurs fournisseurs. Être en conformité vous ouvre des portes commerciales.

Enfin, parce que les sanctions sont dissuasives. Une amende de 3% du chiffre d'affaires mondial, pour une PME de 5 millions d'euros de CA, cela représente 150 000 euros. Sans compter le coût réputationnel et les conséquences opérationnelles d'une mise en demeure.

Maintenant que vous comprenez pourquoi et comment vous faire accompagner, rentrons dans le concret des étapes de mise en conformité. Parce qu'au-delà des principes, ce qui compte, ce sont les actions.

Si l'audit révèle que vous utilisez des systèmes d'IA à risque élevé, c'est la priorité absolue. Ces systèmes exposent votre entreprise aux sanctions les plus lourdes et aux risques opérationnels les plus importants.

La mise en conformité d'un système à risque élevé passe par plusieurs chantiers simultanés :

La documentation technique complète : vous devez pouvoir expliquer précisément comment fonctionne le système, sur quelles données il a été entraîné, quels algorithmes il utilise, quelles sont ses limitations connues. Si vous utilisez un système tiers, cette documentation doit être fournie par votre fournisseur.

Le système de gestion de la qualité : vous devez mettre en place des processus de surveillance continue du système (performance, biais, erreurs) et de gestion des incidents. Cela implique souvent des tableaux de bord de monitoring et des procédures d'escalade en cas de problème.

La traçabilité des décisions : chaque décision prise par le système doit pouvoir être reconstituée et expliquée. Cela nécessite des logs détaillés et structurés, conservés pendant une durée définie (généralement plusieurs années).

La validation humaine effective : un humain formé doit pouvoir intervenir à tout moment dans le processus décisionnel. Ce n'est pas juste un bouton "valider" qu'on clique machinalement, mais une vraie capacité de remise en question et d'override de la décision de l'IA.

Ces chantiers demandent du temps et de l'investissement. C'est pourquoi nous recommandons une approche progressive : sécuriser d'abord les systèmes les plus critiques, puis déployer les mesures sur les autres systèmes à risque élevé.

Pour les systèmes à risque limité (chatbots, générateurs de contenu), la mise en conformité est beaucoup plus simple mais ne doit pas être négligée. L'obligation principale est la transparence : informer clairement les utilisateurs qu'ils interagissent avec une IA.

Concrètement, cela se traduit par :

Des mentions explicites sur vos interfaces : si vous avez un chatbot sur votre site web, ajoutez une mention visible "Vous conversez avec un assistant virtuel alimenté par intelligence artificielle". Pas en tout petit dans les mentions légales, mais directement dans l'interface de chat.

Des watermarks ou mentions sur le contenu généré : si vous utilisez l'IA pour générer des images, textes ou vidéos diffusés publiquement, vous devez indiquer que ce contenu a été généré ou modifié par IA. Un simple "Image générée par IA" en légende suffit généralement.

Une information dans vos CGU/mentions légales : complétez vos documents juridiques avec une section dédiée expliquant votre utilisation de l'IA, les types de systèmes déployés, et les droits des utilisateurs.

Ces modifications sont relativement rapides à implémenter. Chez Apsodia, nous intégrons systématiquement ces éléments dans nos projets de création de site web et d'automatisation.

La conformité AI Act n'est pas un projet avec une date de fin. C'est un état permanent à maintenir. D'où l'importance de mettre en place une gouvernance de l'IA dans votre organisation.

Cette gouvernance peut être formelle (comité dédié, responsable IA nommé) ou plus informelle selon la taille de votre entreprise. L'essentiel est qu'elle existe et qu'elle soit effective.

Les missions de cette gouvernance incluent :

La validation des nouveaux systèmes d'IA : avant de déployer tout nouvel outil ou projet impliquant de l'IA, passage obligatoire par la gouvernance pour évaluation du risque et validation de la conformité.

Le suivi continu des systèmes existants : revue périodique des performances, incidents, évolutions. Mise à jour de la documentation si nécessaire.

La veille réglementaire : l'AI Act va continuer d'évoluer avec des précisions, jurisprudence, guidelines. Quelqu'un doit suivre ces évolutions et adapter vos pratiques en conséquence.

La formation continue des équipes : l'arrivée de nouveaux collaborateurs, l'évolution des pratiques, les retours d'expérience nécessitent une formation régulière.

Cette gouvernance peut sembler lourde, mais elle se construit progressivement. On commence souvent par une simple check-list de validation pour les nouveaux projets, puis on structure au fur et à mesure.

L'AI Act va continuer d'évoluer dans les prochaines années. De nouvelles précisions seront apportées, des guidelines sectorielles seront publiées, la jurisprudence va se construire. Être en conformité aujourd'hui ne garantit pas d'être en conformité dans six mois.

C'est pourquoi nous recommandons fortement de maintenir une relation continue avec vos accompagnateurs. Pas nécessairement un accompagnement quotidien, mais au minimum des points de suivi réguliers (trimestriels par exemple) pour :

Chez Apsodia, nous proposons des formules d'accompagnement récurrent adaptées à chaque contexte. Parce que la conformité AI Act, c'est comme le SEO ou la sécurité informatique : ce n'est jamais vraiment terminé.

Parlons argent. C'est souvent la question qui arrive en premier dans les discussions : "Combien ça va me coûter ?". La réponse n'est pas unique, elle dépend fortement de votre situation.

Le coût d'une mise en conformité AI Act se décompose en plusieurs postes :

L'audit initial et le conseil juridique : entre 3 000 et 15 000 euros selon la complexité de votre organisation. Une PME avec 2-3 systèmes d'IA simples sera dans la fourchette basse. Une ETI avec de nombreux systèmes et des usages à risque élevé sera dans la fourchette haute.

Les adaptations techniques : très variable selon vos systèmes. Pour de simples ajouts de mentions de transparence sur vos interfaces, comptez quelques centaines d'euros. Pour la mise en place de systèmes de traçabilité et monitoring sur des outils à risque élevé, le budget peut atteindre 10 000 à 50 000 euros.

La formation de vos équipes : entre 1 000 et 5 000 euros selon le nombre de personnes concernées et le format (formation collective, e-learning, sessions dédiées par service).

La maintenance et le suivi : budget annuel récurrent entre 2 000 et 10 000 euros pour la veille réglementaire, les mises à jour de conformité, et l'accompagnement sur les nouveaux projets.

Au total, pour une PME classique, un budget global entre 8 000 et 30 000 euros pour la première année permet de couvrir l'essentiel. Ce n'est pas négligeable, mais c'est à mettre en perspective avec les risques.

Les amendes de l'AI Act sont médiatisées : jusqu'à 7% du chiffre d'affaires mondial pour les infractions les plus graves. Mais le vrai coût de la non-conformité va bien au-delà des sanctions financières.

Le coût réputationnel : dans un monde où la confiance dans l'IA est fragile, être épinglé pour non-conformité peut détruire votre image de marque. Les médias adorent ce genre de sujets. Vos concurrents l'utiliseront contre vous.

Le coût commercial : de plus en plus d'appels d'offres intègrent des critères de conformité AI Act. Ne pas être en règle vous exclut d'office. Dans certains secteurs (banque, santé, RH), la conformité devient un prérequis absolu pour travailler.

Le coût opérationnel : une mise en demeure vous oblige à tout arrêter en urgence pour vous mettre en conformité. Sous pression, dans la précipitation, avec des équipes stressées. C'est toujours plus coûteux et moins efficace qu'une approche anticipée et structurée.

Le coût juridique : en cas de litige avec un client, un employé ou un candidat, la non-conformité AI Act peut être un élément aggravant qui joue contre vous devant les tribunaux.

Quand on additionne tous ces risques, l'investissement dans la conformité apparaît comme une assurance très raisonnable. D'autant que, comme nous l'avons vu, elle améliore aussi la qualité de vos processus et peut devenir un argument commercial.

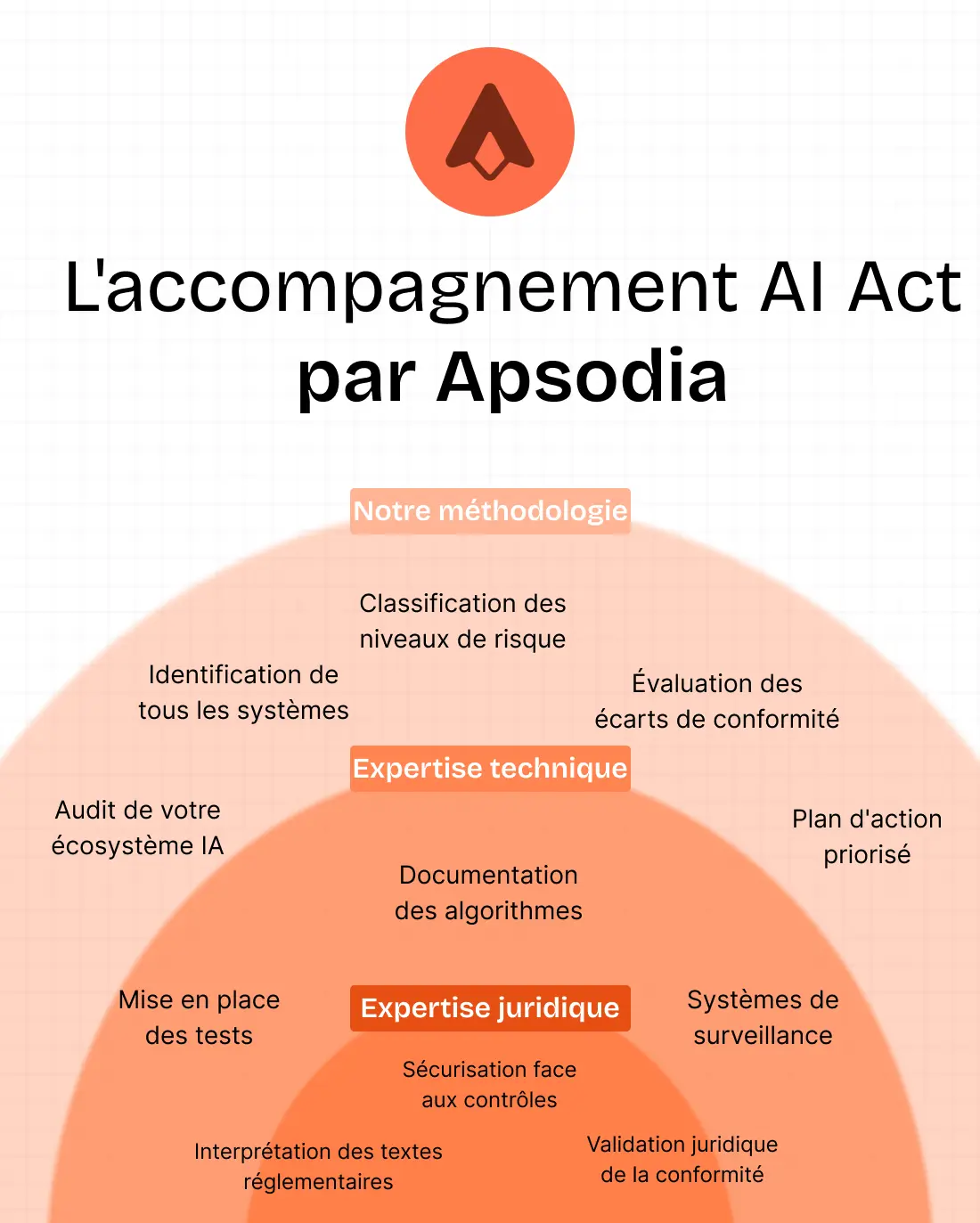

Vous l'avez compris, notre approche de la conformité AI Act n'est pas celle d'un cabinet juridique classique ni celle d'un cabinet de conseil stratégique. Nous sommes une agence digitale qui fait de l'IA au quotidien, et c'est précisément cette expertise terrain qui fait notre différence.

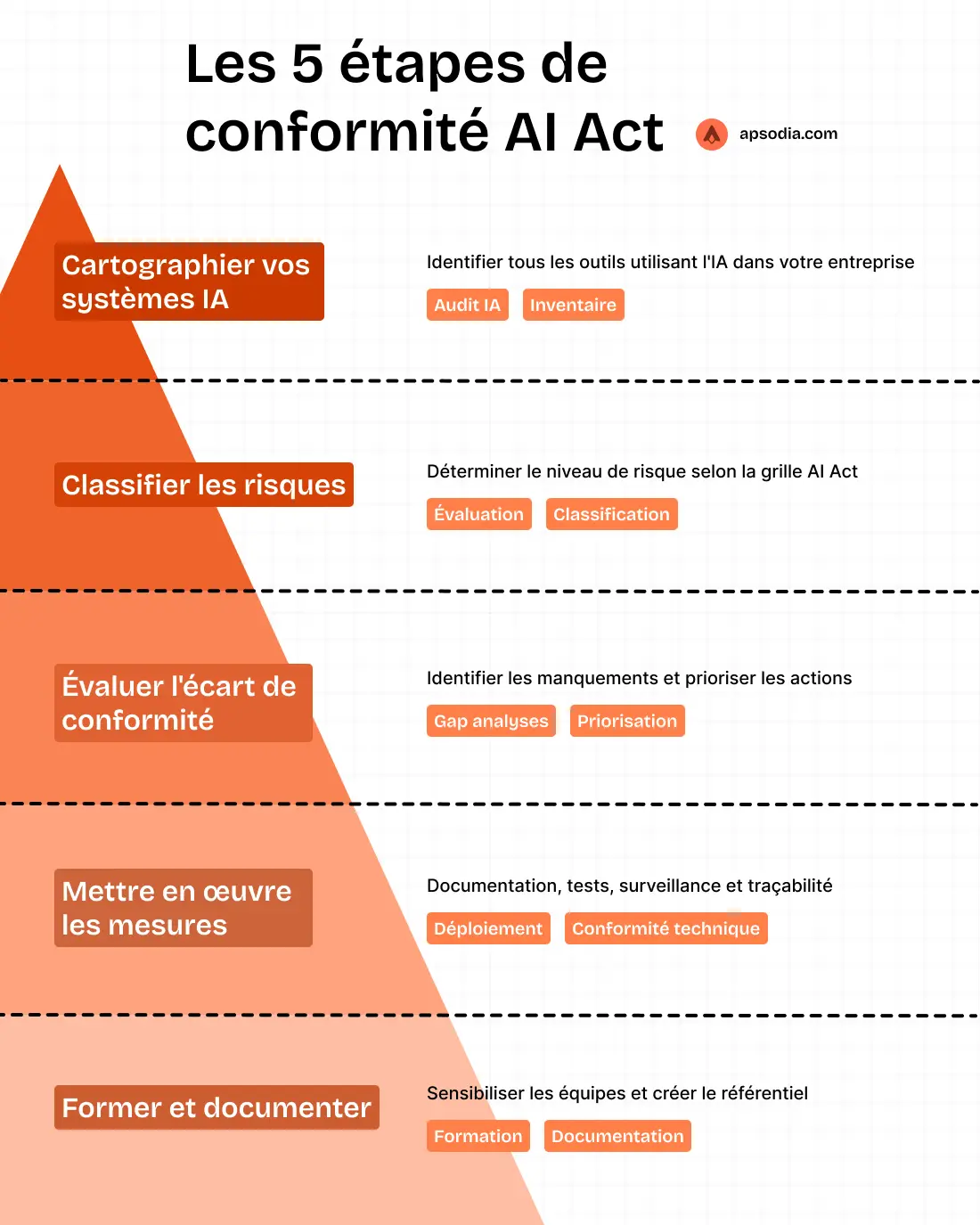

Nous avons développé une méthodologie spécifique qui combine efficacité et pédagogie. Elle se déroule en cinq étapes claires :

Étape 1 : Kick-off et immersion (1 journée)Nous commençons par comprendre votre métier, vos processus, votre organisation. Nous rencontrons les personnes clés : direction, DSI, responsables métiers utilisateurs d'IA. Cette phase d'immersion est cruciale pour éviter les erreurs d'analyse.

Étape 2 : Audit technique et cartographie (2-3 jours)Nous analysons tous vos systèmes d'IA, vos outils, vos automatisations. Nous récupérons la documentation existante, nous échangeons avec vos équipes techniques, nous testons vos interfaces. Nous produisons la cartographie complète de vos usages d'IA avec classification des risques.

Étape 3 : Analyse juridique (3-5 jours via notre cabinet partenaire)Notre cabinet d'avocats spécialisé en droit numérique prend le relais pour l'analyse juridique approfondie. Ils valident la classification, identifient les obligations précises, et construisent la stratégie de conformité. Ils produisent également les premiers documents juridiques nécessaires.

Étape 4 : Plan d'action et priorisation (1 journée en atelier collaboratif)Nous vous présentons les résultats de l'audit et l'analyse juridique. Ensemble, nous construisons le plan d'action de mise en conformité avec des priorités claires et des échéances réalistes. Nous intégrons vos contraintes opérationnelles et budgétaires.

Étape 5 : Accompagnement à la mise en œuvre (durée variable)Nous vous accompagnons concrètement dans le déploiement des mesures de conformité. Adaptations techniques, rédaction de documentation, formation des équipes, mise en place des processus. Nous avançons à votre rythme, par sprints, avec des validations régulières.

Cette méthodologie n'est pas figée. Nous l'adaptons à chaque contexte, selon votre maturité sur l'IA, votre secteur d'activité, vos contraintes spécifiques.

Notre partenariat avec un cabinet d'avocats spécialisé n'est pas un simple arrangement commercial. C'est une conviction profonde : la conformité AI Act nécessite une double expertise indissociable.

L'expertise IA (notre cœur de métier chez Apsodia) permet de :

L'expertise juridique (apportée par notre cabinet partenaire) permet de :

C'est cette combinaison qui vous donne la sécurité juridique ET l'efficacité opérationnelle. Trop souvent, les accompagnements purement juridiques produisent des recommandations théoriquement correctes mais difficiles à implémenter en pratique. À l'inverse, les approches purement techniques passent à côté de subtilités juridiques qui peuvent avoir des conséquences graves.

Travailler sur un sujet aussi sensible que la conformité réglementaire nécessite des garanties claires. Voici celles que nous vous apportons :

Transparence totale sur notre méthodologie : avant même de commencer, vous savez exactement comment nous allons travailler, quelles seront les étapes, quels seront les livrables. Pas de boîte noire ni de surprises en cours de route.

Engagement de résultat sur les livrables : nous nous engageons sur la production des documents et analyses prévus, avec un niveau de qualité contractualisé. Si un livrable ne vous convient pas, nous le retravaillons jusqu'à satisfaction.

Confidentialité absolue : nous signons systématiquement un NDA couvrant toutes les informations sensibles auxquelles nous accédons. Votre stratégie, vos process internes, vos données clients restent confidentiels.

Continuité de l'accompagnement : nous ne vous lâchons pas après la livraison des documents. Nous restons disponibles pour répondre à vos questions, vous aider à implémenter les recommandations, et assurer le suivi dans le temps.

Veille réglementaire intégrée : dans le cadre de nos formules d'accompagnement récurrent, nous assurons une veille active sur l'évolution de l'AI Act et vous alertons dès qu'une modification impacte votre situation.

Notre objectif, c'est que vous puissiez vous concentrer sur votre cœur de métier en ayant la tranquillité d'esprit que votre conformité AI Act est sous contrôle. Pas de charge mentale supplémentaire, pas de stress réglementaire, juste la sécurité de savoir que c'est pris en charge par des experts.

Cela dépend fortement de votre situation de départ et du nombre de systèmes d'IA concernés. Pour une PME avec quelques systèmes à risque limité ou minimal, comptez 2 à 3 mois entre le démarrage de l'audit et la finalisation de la mise en conformité. Pour une organisation plus complexe avec des systèmes à risque élevé, plutôt 4 à 6 mois. L'essentiel est de ne pas retarder le démarrage : plus vous commencez tôt, plus vous avez de marge de manœuvre pour avancer sereinement.

Oui et non. Techniquement, tout système d'IA utilisé dans l'UE est dans le périmètre de l'AI Act. Mais les obligations varient énormément selon le niveau de risque. Un simple filtre anti-spam (risque minimal) n'a aucune obligation spécifique. Un chatbot (risque limité) doit juste informer l'utilisateur. Un système RH automatisé (risque élevé) doit respecter des dizaines de critères stricts. L'enjeu est donc d'abord de classifier correctement vos systèmes pour connaître vos obligations réelles.

À court terme, probablement rien. Les autorités de contrôle sont encore en phase de montée en puissance et privilégient pour l'instant la sensibilisation plutôt que la répression. Mais cette fenêtre de bienveillance ne durera pas. D'ici 2026-2027, les contrôles vont se multiplier et les premières sanctions tomber. Au-delà des amendes potentielles, vous prenez le risque d'être exclu d'appels d'offres, de perdre la confiance de vos clients, et de vous retrouver en difficulté en cas de litige. L'inaction coûte finalement plus cher que l'action.

Utiliser ChatGPT, Claude ou d'autres outils d'IA générative n'est pas interdit, loin de là. Mais vous devez le faire de manière contrôlée et documentée. Les questions à vous poser : vos collaborateurs savent-ils quelles données ils peuvent ou non partager avec ces outils ? Existe-t-il une charte d'utilisation ? Les usages sont-ils tracés et contrôlés ? Si vous utilisez ces outils pour des tâches à risque (scoring commercial, pré-sélection de CV), les obligations sont-elles respectées ? L'enjeu n'est pas d'interdire ces outils mais d'en encadrer l'usage intelligemment.

C'est une des questions les plus complexes de l'AI Act. Le texte donne des listes de cas d'usage par niveau de risque, mais l'interprétation n'est pas toujours évidente. Règle générale : si votre système d'IA prend ou influence significativement des décisions concernant des personnes (recrutement, évaluation, octroi de crédit, accès à des services), vous êtes probablement en risque élevé. Si votre système génère du contenu ou interagit avec des utilisateurs sans impact décisionnel majeur, vous êtes plutôt en risque limité. Mais seule une analyse au cas par cas permet de trancher définitivement, d'où l'importance d'un audit professionnel.

L'AI Act peut sembler intimidant au premier abord. Encore un texte réglementaire à digérer, encore des obligations à respecter, encore des investissements à prévoir. Mais si vous changez de perspective, vous réalisez rapidement que c'est aussi une opportunité.

Une opportunité de structurer vos pratiques IA, souvent déployées de manière un peu anarchique jusqu'ici. Une opportunité d'améliorer la qualité et la sécurité de vos processus. Une opportunité de rassurer vos clients et partenaires. Une opportunité de vous différencier commercialement dans un marché où la conformité devient un critère de choix.

La vraie question n'est pas "dois-je me mettre en conformité AI Act ?" - la réponse est oui, c'est une obligation légale. La vraie question est "comment vais-je m'y prendre pour que ce soit efficace et le moins douloureux possible ?".

La réponse, c'est de vous faire accompagner par des experts qui combinent expertise technique en IA et conseil juridique de qualité. Des experts qui comprennent votre métier, vos contraintes, vos enjeux. Des experts qui ne vous livrent pas juste un rapport théorique mais vous accompagnent concrètement jusqu'à la mise en conformité effective.

Chez Apsodia, c'est exactement ce que nous faisons au quotidien. Parce que nous travaillons sur l'intelligence artificielle depuis des années, parce que nous avons noué un partenariat solide avec un cabinet d'avocats spécialisé, parce que nous connaissons les réalités du terrain des PME et ETI.

Ne laissez pas l'AI Act devenir une source de stress et d'incertitude. Transformez-le en projet structurant pour votre entreprise. Commencez par un audit pour savoir où vous en êtes. Puis construisez votre feuille de route de conformité, étape par étape, de manière pragmatique et réaliste.

Le temps de l'attentisme est révolu. Les autorités de contrôle montent en puissance, les premiers contrôles arrivent, vos concurrents avancent. Plus vous agissez tôt, plus vous avez de marge de manœuvre et moins c'est coûteux. L'AI Act n'est plus une menace lointaine, c'est une réalité opérationnelle immédiate.

Diagnostic personnalisé et plan d'action par nos experts